Un software juzga a las personas según sus rasgos faciales

La inteligencia artificial resucita la frenología pero lo llama Inferencia automatizada de la criminalidad usando imágenes faciales

|

| Esther Eggers, Reformatorio para mujeres de Long Bay, 1919 |

No se tienen pruebas de que Marco Valerio Levino,

un general romano del siglo III a.C., dijese aquello de "cuando tengas

dudas entre dos presuntos criminales, elige al más feo", pero la

Universidad de Cornell, en EEUU, hoy le daría la razón. En 2011 publicaron un estudio que

defendía que las personas feas tienen más probabilidades de ir a la

cárcel que las guapas. Y ahora, unos investigadores chinos dicen ser

capaces de predecir la personalidad de las mujeres con tan solo mirar su

fotografía.

La historia salió a la luz en noviembre,

pero este es el segundo capítulo. Los científicos de la Universidad de

Jiao Tong, en Shangái, mezclaron inteligencia artificial con machine learning

y le añadieron un poco de imaginación. El resultado fue un estudio en

el que defendieron que las máquinas eran capaces de predecir a un futuro

criminal basándose en sus rasgos faciales. Lo llamaron Inferencia automatizada de la Criminalidad usando Imágenes Faciales. Luego fue publicado en arXiv,

un portal de la Universidad de Cornell que actúa como filtro preliminar

de los trabajos que luego serán aceptados de forma oficial por la

escuela.

El nuevo estudio se titula Inferencia automatizada en las impresiones sociopsicológicas del atractivo femenino. También lo han subido a arXiv, y también han utilizado machine learning

para desarrollarlo. Los tres investigadores han recopilado la foto de

3.954 mujeres en Baidu (el Google chino) y las han dividido en positivas

y negativas.

|

| Las imágenes, divididas en positivas (S+) y negativas (S-) |

Las fotos "positivas" están asociadas a las

búsquedas que contienen palabras como "guapa", "elegante", "tierna",

"linda", "dulce" y "cuidada"; mientras que las negativas se relacionan

con "pretenciosa", "pomposa", "indiferente" y "coqueta". Para estar

seguros de haber elegido los conceptos correctos, los investigadores

preguntaron a 22 universitarios chinos si estaban de acuerdo con las

etiquetas.

Los dos grupos de imágenes se usaron después para entrenar a una red neuronal convolucional.

Estas redes se diferencian de las redes neuronales sencillas en que

están especializadas en tratamiento de imágenes y procesamiento del

lenguaje, lo que permite a los investigadores codificarlas de manera

diferente. La red diferenció entonces 2.000 imágenes como positivas y

1.954 como negativas. "Las dos clases de imágenes reflejan las

preferencias estéticas y los juicios de valor que prevalecen entre los

varones en la China contemporánea", sostienen.

A mayor maquillaje menos naturalidad

"La red neuronal es precisa infiriendo percepciones sociopsicológicas

de las mujeres atractivas chinas. Esto es bastante importante dado el

hecho de que incluso los observadores humanos tuvieron dificultades

racionalizando sus percepciones sociopsicológicas de las caras de

prueba", continúan. Los 22 universitarios situaron en la categoría

negativa a las mujeres que consideraban "poco naturales" y los

investigadores analizaron el contraste de las fotografías y la

saturación en busca de altos niveles de maquillaje. Y acertaron.

Las fotografías en la categoría positiva tenían de media un 13,84%

menos de contraste y casi un 5% menos de saturación del color que las

imágenes de la categoría negativa. La red neuronal detectó lo mismo que

los hombres y las juzgó de la misma forma que ellos: cuanto más

maquillaje, menos natural. Pero los investigadores no pueden explicar

qué relación hay entre llevar más maquillaje y ser peor persona. Como la

frenología no pudo hacerlo a comienzos del siglo XIX.

|

| Las imágenes, divididas en positivas (S+) y negativas (S-) |

La frenología dos siglos después

Sabemos que el machine learning puede conseguir que una máquina identifique caras pixeladas, que una IA gane al mejor jugador de Go del mundo o al de StarCraft.

Pero los investigadores de la universidad de Jiao Tong no exploran una

idea nueva: la frenología ya intentó predecir conductas delictivas y

criminales con los rasgos faciales. Fue desterrada poco más tarde por no

contar con base científica suficiente, ya que asumía que las

variaciones del cráneo humano eran la llave que explicaba los trastornos

psíquicos o las enfermedades mentales.

El primer

estudio de los chinos en noviembre estaba más cerca de esta

pseudociencia que del campo científico. La investigación fue bastante

controvertida ya que hubo quien aseguró que carecían de base científica,

como el periodista de Quartz, Dave Gershgon. Sin embargo, sí hubo otros que la apoyaron, como Sam Biddle en The Intercept.

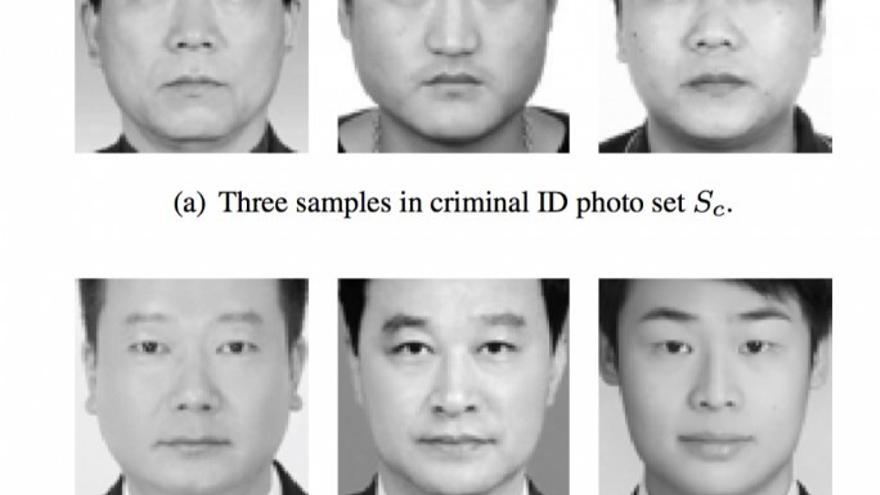

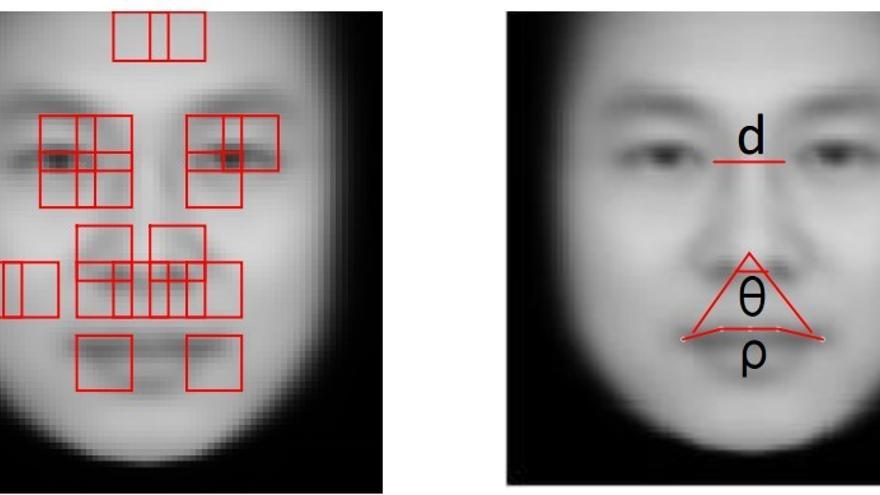

Los investigadores enseñaron al sistema 1.856 fotografías de chinos y

chinas entre 18 y 55 años, encontrándose según ellos con "algunas

características estructurales discriminatorias" que eran determinantes para predecir la criminalidad,

como "la curvatura de los labios, la distancia entre los ojos y el

ángulo entre la boca y nariz". Para que funcionase, los sujetos de

pruebas no podían tener barba ni cicatrices ni ningún otro tipo de marca

en sus rostros. 965 fotos correspondían a criminales, y utilizando una

red neuronal similar a la del segundo estudio, consiguieron que el

algoritmo identificase con éxito al 89,51% de los sujetos.

|

| Inferencia Automatizada de la Criminalidad usando Imágenes Faciales |